Notre cerveau nous trompe et nous voyons la réalité telle que nous sommes (plutôt que comme la réalité est).

Dans son livre Votre cerveau vous joue des tours (éditions Allary), Albert Moukheiber explique pourquoi notre cerveau n’est pas toujours fiable. Notre cerveau nous trompe. Nous voyons la réalité telle que nous sommes plutôt que comme elle est : cela mène à des dialogues de sourds (et de la violence).

Le cerveau humain est un filtre.

Nos yeux, nos oreilles, notre peau et tous nos sens sont juste des récepteurs qui transmettent l’information du monde extérieur à notre centre de traitement des informations (à savoir le cerveau) qui décide ensuite de la réaction à avoir.

Les informations de l’environnement perçues par les sens passent par un filtre (le cerveau) et ce filtre va analyser ces informations puis décider d’une réaction. Le problème vient du fait qu’il y a beaucoup d’informations dans ce filtre. Le cerveau doit prendre des décisions assez rapidement et utilise une technique approximative qui marche à peu près bien : les heuristiques.

Le cerveau humain ne peut pas fonctionner sans ces heuristiques. Par exemple, quand on serre la main de quelqu’un, on ne calcule pas la vitesse du bras et la rotation du poignet pour avoir le bon angle et la bonne pression. Avec l’entraînement, nos modèles heuristiques s’améliorent et on devient meilleur à faire cette chose. Chez les enfants qui apprennent à marcher, on peut voir le modèle heuristique s’améliorer jusqu’à ce qu’ils y arrivent (ce qui passe par des chutes, des essais-erreurs, le besoin d’appui, une marche vacillante au début).

Le cerveau reconstruit la réalité et invente du sens pour comprendre le monde.

Parfois, notre cerveau invente un sens face à quelque chose qu’il ne comprend pas dans le monde. Le cerveau a tendance à raisonner ainsi : “Il faut le croire pour le voir” (et non pas “Il faut le voir pour le croire”).

Quand le cerveau n’a pas assez d’informations pour comprendre la réalité, il prend une décision (celle qui lui paraît la plus probable) et attribue sa croyance à la réalité. Le cerveau va porter son a priori perceptif sur l’élément qu’il n’arrive pas à comprendre.

Or il y a autant d’a priori que de cerveaux humains et donc autant de réalités construites que de cerveaux : on comprend alors que certaines personnes n’arrivent jamais à se mettre d’accord car elles voient réellement deux vérités différentes. Ce n’est plus une différence d’opinion, c’est une perception différente de l’environnement extérieur.

Il est exact de dire que notre cerveau reconstruit la réalité et nous voyons la réalité telle que nous sommes (plutôt que comme la réalité est). Ainsi, notre pensée peut nous induire en erreur, aussi bien dans nos raisonnements que dans nos décisions.

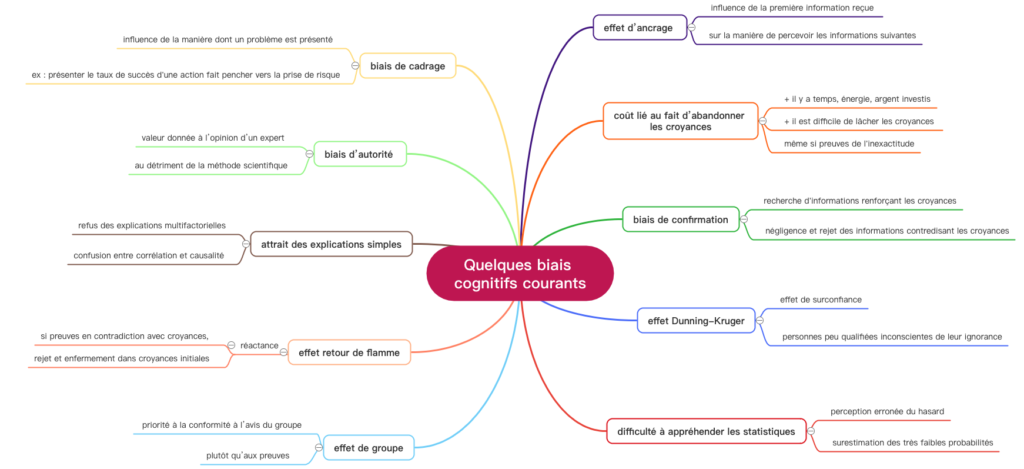

Quand le cerveau nous trompe : les biais cognitifs

Les biais cognitifs sont inévitables.

Les erreurs sont particulièrement intéressantes quand on s’intéresse au raisonnement humain. C’est ce qu’on appelle des biais cognitifs. Les biais cognitifs sont inévitables car c’est le principe même du fonctionnement humain que de s’appuyer sur des heuristiques, rapides mais pas toujours justes.

Certains chercheurs ont théorisé qu’on a deux systèmes de pensée :

- un système rapide qu’on utilise dans nos heuristiques (le système 1),

- un système plus lent qui produit des pensées plus rationnelles, sans pour autant assurer que ces pensées soient toujours dans le vrai (le système 2).

Cela signifie que nous devons inhiber la première réponse rapide du système 1 qui nous vient à l’esprit pour ensuite donner une réponse exacte. Pourtant, même les pensées issues du système 2 peuvent être biaisées par des biais cognitifs (qui sont nombreux !)

Par exemple, le biais de cadrage a montré que, sans changer la nature ni la quantité ou le prix des objets mais en introduisant une variable supplémentaire, on peut changer les décisions prises par les humains (sans qu’ils en soit conscients). Un exemple explicite est le fait de présenter une même quantité de nourriture dans des assiettes de différentes tailles : la même quantité sera perçue comme plus ou moins importante selon si l’assiette est grande ou petite.

A noter que nous pouvons tout autant être manipulés que nous manipuler nous-mêmes.

Il est donc important :

- d’avoir connaissance de l’existence de biais cognitifs humains,

- de savoir identifier une information fiable, basée sur la méthode scientifique.

Se familiariser avec la méthode scientifique et se méfier de l’influence sociale

La méthode scientifique, c’est tout d’abord l’expérimentation dans des conditions contrôlées et la reproduction des expériences. Quand les avis et recommandations des agences sanitaires et des académies sont convergents à l’échelle internationale, on peut estimer qu’ils reflètent un consensus scientifique sur lequel s’appuyer.

Pour obtenir une information fiable (dans l’état actuel des connaissances), il faut :

- Qu’elle soit dans notre espace/temps (prouver que Dieu existe ne peut pas se faire avec la méthode scientifique car il est qualifié d’omniprésent donc ni dans notre espace ni dans notre temps)

- Savoir exactement ce que l’on cherche

- Être prêt à le prouver

- Se donner autant de chances d’avoir tort que raison

- Prendre en compte les faits

- Partager l’expérience pour que des gens la reproduisent

Un scientifique honnête va partager les résultats de ses expériences et les détails de sa démarche avec ses pairs. Il va également envoyer le protocole de son expérience à une revue spécialisée qui sollicitera d’autres scientifiques afin que ces derniers la valident ou non. Si les autres scientifiques la valident, elle sera publiée dans la revue. Même avec ce processus de revue par le pairs, des erreurs peuvent subsister, mais ce système d’autocritique permet de sélectionner des informations aussi fiables que possible. De plus, d’autres scientifiques peuvent refaire l’expérience dans les mêmes conditions afin de vérifier les résultats… et éventuellement les réfuter s’ils se révèlent faux. Le scientifique à l’origine du résultat initial peut alors se rétracter : c’est ainsi que la science avance, par essais/ erreurs selon une méthode rigoureuse qui vise à éviter au maximum les biais cognitifs.

L’influence sociale nous fait adhérer à ce que disent les personnes qui nous sont proches, physiquement ou en matière de représentation du monde, c’est-à-dire en matière de valeurs. Si nous discréditons d’emblée toute idée émise par des personnes dont les opinions nous dérangent, nous maximisons nos risques d’être manipulés par des personnes faisant autorité dans le groupe auquel nous nous identifions. On ne peut être trahi que par les personnes auxquelles nous accordons notre confiance. En conséquence, les influences les plus puissantes sont celles qu’exercent les individus auxquels nous nous fions et c’est face à celles-ci dont nous devons le plus faire preuve d’esprit critique avec méthodologie.

Les biais cognitifs ont une utilité : il ne s’agit pas de lutter contre eux, mais de les conscientiser pour cheminer vers moins de violence.

Les biais cognitifs sont indispensables à l’espèce humaine.

Pour autant, les biais cognitifs sont utiles à l’espèce humaine pour plusieurs raisons :

- ils assurent des repères qui permettent la vie en société;

- si nous n’étions sûrs de rien, nous serions déboussolés, nous ne pourrions jamais prendre de décisions, nous serions torturés par des doutes incessants.

Quant aux heuristiques du système 1, ils permettent la survie : face à un danger imminent, la fuite immédiate sans passer par le système lent est la meilleure solution en termes de survie.

Albert Moukheiber rappelle que ces biais jouent aussi un rôle utile dans la vie sociale. Parfois, grâce au biais de sélection, nous choisissons de ne garder en mémoire que les moments agréables passés avec nos proches, plutôt que les disputes ou les moments difficiles. Le docteur en neurosciences prend avec malice l’exemple d’un coup de fil d’un ami : lorsqu’un ami nous appelle et qu’on lui répond « j’étais justement en train de penser à toi », nous déclenchons un biais de confirmation et oublions alors toutes les fois où nous avons pensé à cet ami sans qu’il appelle. Sans ce biais de confirmation, nous aurions plus de mal à créer des liens sociaux.

Toutefois, il est possible de prendre conscience qu’il existe des biais cognitifs dans le cerveau et de nuancer la réalité que nous percevons par l’effet de ces biais. Cela ne peut se faire que dans un temps long car notre cerveau a tendance à aller au plus simple (écraser la réalité pour la faire rentrer dans des cases, diviser et faire des catégories, polariser). Ce que le cerveau nous fait gagner en rapidité nous le fait perdre en nuance et en richesse.

Nous pouvons apprendre à douter de nos pensées, de nos intuitions et de créer une pause avant d’agir. Ce type de doute doit être méthodique, à ne pas confondre avec le fait de douter de tout et remettre toute information en question. Le but est de savoir à quel moment douter, et à quel moment faire confiance en adoptant un mode de pensée graduel (j’en sais beaucoup / j’en sais peu) plutôt que binaire (je sais / je ne sais pas). Il est plus intéressant de voir pourquoi on élabore un raisonnement plutôt qu’un autre. Cela nécessite de ne pas s’identifier à des opinions afin de ne pas se sentir attaqué en cas de preuves contradictoires. L’esprit critique nous invite à éviter l’attaque ou la défense dans le but de nous faire reconnaître ou protéger notre identité.

Pour aller plus loin : De l’esprit critique dans la parentalité positive ?

Les dialogues de sourds reposent sur l’adhésion à des valeurs différentes.

Quand on est attaché à une opinion, on va avoir tendance à ne pas croire, et même pire à ne pas voir, les informations qui contre disent cette opinion (au risque de rester dans le faux). Le biais de confirmation est un biais cognitif qui consiste à chercher des informations qui vont renforcer nos croyances, et à ignorer (même inconsciemment), à relativiser ou à rejeter les informations qui ne vont pas dans le sens de nos croyances. De même, l’effet retour de flamme pourrait être lié à notre degré d’adhésion à certaines valeurs. Quand nous sommes confrontés à des preuves contredisant nos croyances, nous avons tendance à les rejeter et à nous refermer davantage sur nos croyances initiales, sous-tendues par des valeurs. Plus on adhère à une valeur, plus on est attaché aux croyances qui s’y rapportent et ces croyances se retrouvent paradoxalement renforcées par des preuves contradictoires. En effet, il est désagréable, voire insupportable, d’avoir tort.

En réalité, nos opinions reposent sur des valeurs, plutôt que sur des faits (et nous persévérons dans des dialogues de sourds).

Ainsi, les questions importantes ne peuvent pas être tranchées seulement avec plus de faits sourcés, plus de données chiffrées ou plus d’exemples. Les positions et avis des uns et des autres reflètent une vision du monde qui leur paraît légitime et plus souhaitable que d’autres (et même LA meilleure, à imposer aux autres). Cela signifie qu’il ne suffit pas de dévoiler la réalité pour qu’une personne la reconnaisse comme la réalité.

Nous pouvons reconnaître les valeurs qui sous-tendent la position défendue par les personnes avec lesquelles nous sommes en désaccord afin de ne pas tomber dans des discussions stériles, voire violentes. On parle ici ni plus ni moins que d’empathie pour la position adverse (par exemple, “Oh, je vois, donc pour toi, c’est important de protéger la liberté individuelle et c’est ce qui devrait primer. C’est la raison pour laquelle tu penses que…”). Cela ne signifie pas pour autant que toutes les opinions se valent. Le relativisme est une dérive de la pensée contemporaine. Ce relativisme stipule que tout se vaudrait et il n’y aurait pas besoin d’apporter de preuves d’une opinion pour soutenir que cette opinion vaut autant qu’un discours argumenté, avec des sources solides et valides. Ainsi, dire que les chambres à gaz ou les camps d’extermination n’ont jamais existé est faux et ne pourra jamais être vrai même si la personne qui soutient cette thèse apporte des prétendues “sources” pour appuyer ses propos. Toutefois, on peut essayer de comprendre la vision du monde qui sous-tend ces affirmations afin de les démonter plus efficacement, en se connectant aux valeurs imperméables au raisonnement factuel et chiffré. Parfois, un rappel de la loi est utile : dans le cas de propos négationnistes, ils sont punis par la loi.

Activer notre propre vigilance épistémique (plutôt que chercher les biais chez les autres)

L’esprit critique est d’abord une démarche à appliquer à soi-même. L’esprit critique n’est pas une traque aux biais cognitifs chez les autres.

Quand on est attaché au processus (méthode scientifique) plutôt qu’à l’opinion (la croyance), on peut développer de la flexibilité mentale et cette flexibilité mentale est précisément la condition de la non violence. La vigilance épistémique est un concept de Dan Sperber, définie comme la faculté que nous avons de traiter une information avant de l’intégrer à notre représentation du monde. Quand nous faisons preuve de vigilance épistémique, nous augmentons nos chances de ne pas croire (ni relayer) des informations de mauvaise qualité ou trompeuses.

Thomas Durand, cofondateur de la chaîne La tronche en biais, rappelle dans son livre Quand est-ce qu’on biaise ? que les problèmes se posent avec les sujets pour lesquels nous avons peu (voire aucune) compréhension. Dans ce cas, nous devons mobiliser beaucoup d’efforts pour compléter notre compréhension du monde ou bien évaluer le degré de crédibilité de la thèse défendue, en fonction de la confiance que nous accordons à la compétence de la source. Thomas Durand parle d’effort dans le sens où nous avons tendance à relâcher notre vigilance épistémique face à une personne à laquelle nous faisons habituellement confiance. En général, nous ne remettons pas systématiquement et méthodiquement en cause les moindres paroles d’un expert dont la compétence a déjà été éprouvée par le passé (du fait d’un diplôme, de recherches en lien avec le sujet, de livres au succès littéraire, de prospectives qui se sont révélées justes dans le passé, de prix ou récompenses reçues…). Une personne ne doit jamais faire autorité. Il nous est très difficile d’admettre qu’une information peut être fausse alors qu’elle provient d’une source que nous aimons bien ou que nous tenons pour qualitative, pour fiable.

Lire aussi : Esprit critique : activer notre vigilance épistémique

La pensée ouverte, un antidote à la violence ?

Je fais le lien entre ce que les neurosciences nous apprennent sur le fonctionnement du cerveau et ce que Daniel Favre, spécialiste de l’éducation et de la violence scolaire, écrit : il estime que l’enseignement de la pensée ouverte est un antidote à la violence des enfants et adolescents. Cela fonctionne aussi pour les adultes. Selon Daniel Favre, une pensée dogmatique est caractérisée par quatre postures :

- la personne a recours à l’implicite pour s’exprimer (elle a du mal à s’expliquer, à donner des définitions, à classifier, à trouver des mots justes),

- ce que la personne dit a valeur de vérité absolue et ses jugements sont définitifs (elle ne pose pas – ou peu – de questions, elle ne formule pas d’hypothèse potentiellement questionnable et qu’elle pourra admettre comme fausse en cas de preuve contradictoire, elle a du mal à émettre des jugements provisoires),

- l’argumentation ne vise qu’à prendre en compte les faits et informations qui confirment l’a priori personnel en négligeant tous les autres (les contre exemples sont écartés, la remise en contexte est impossible),

- les généralisations sont abusives (avec des mots comme toujours, jamais, tous/ toutes…),

- la personne occulte ses sensations et ses propres émotions mais les extériorise en les projetant sans s’en rendre compte sur les autres, voire sur des objets (le “je” disparaît au profit de l’autre – “il m’a cherché” – ou du groupe).

La violence se nourrit et croît plus facilement dans la pensée dogmatique où implicite, certitude et projection s’engendrent mutuellement, accompagnés par l’émotion grisante d’être dans la vérité. L’éducation à la pensée ouverte peut constituer un bon antidote. – Daniel Favre

………………………………………………………….

Pour aller plus loin : Votre cerveau vous joue des tours d’Albert Moukheiber (éditions Allary). Disponible en médiathèque, en librairie ou en ecommerce.

Commander Votre cerveau vous joue des tours sur Amazon, sur Decitre, ou sur la Fnac